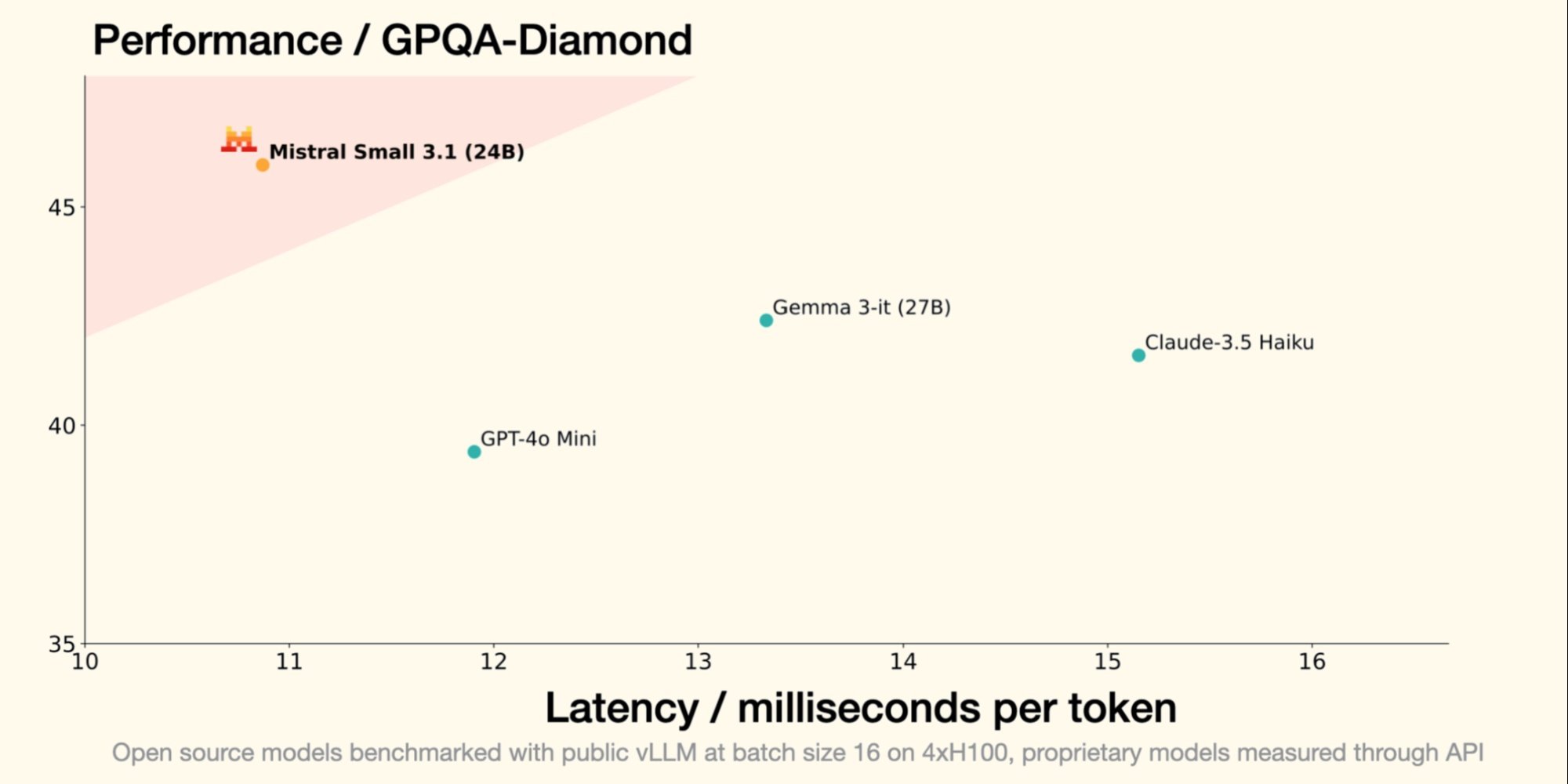

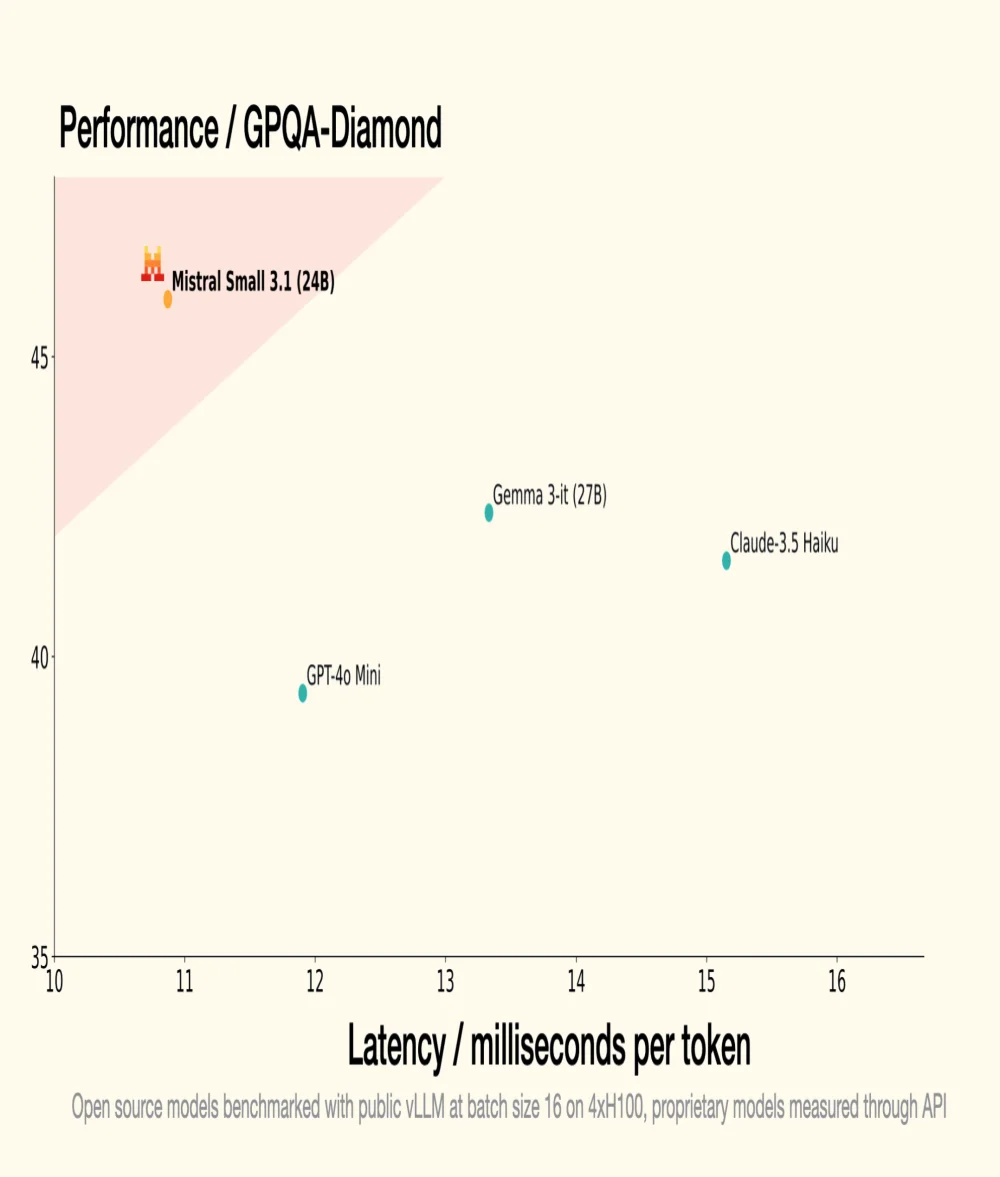

Geçtiğimiz 30 Ocak'ta, Fransız GenAI unicornu Mistral AI, 24 milyar parametreye sahip bir LLM olan Small 3'ü tanıtarak, bir LLM'nin etkili olması için astronomik sayıda parametreye ihtiyaç duymadığını gösterdi. Halefi Small 3.1, kompakt mimarisini korurken, performans, çok modlu anlama ve uzun bağlam yönetimi açısından önemli iyileştirmeler sunarak Google'ın Gemma 3-it 27B ve OpenAI'nin GPT-4o Mini gibi modelleri geride bıraktı.

Kaynak: Mistral AI

Performans Optimizasyonu

-

Eğitimli bir sürüm, Mistral Small 3.1 Instruct, dil anlama ve konuşma görevleri için kullanıma hazırdır;

-

Önceden eğitilmiş bir sürüm, Mistral Small 3.1 Base, belirli alanlarda (sağlık, finans, hukuk vb.) ince ayar ve uzmanlaşma için idealdir.

-

Small 3.1 Instruct, Google'ın Gemma 3-it (27B) modelinden metin, çok modlu ve çok dilli görevlerde daha iyi performans gösterir;

-

GPT-4o Mini'yi OpenAI'den MMLU, HumanEval ve LongBench v2 gibi karşılaştırmalarda, 128.000 token'a genişletilmiş bağlam penceresi sayesinde aşar;

-

Claude-3.5 Haiku'yu uzun bağlamlar ve çok modlu veriler içeren karmaşık görevlerde aşar;

-

Cohere Aya-Vision (32B) modeline karşı ChartQA ve DocVQA gibi çok modlu karşılaştırmalarda, gelişmiş görsel ve metinsel veri anlama göstererek üstünlük sağlar;

-

Small 3.1, çok dillilikte yüksek performans sergileyerek, Avrupa ve Asya dilleri gibi kategorilerde rakiplerini geride bırakır.

Daha iyi anlamak

LLM (Large Language Model) nedir, teknoloji ve işleyiş açısından nasıl çalışır?

LLM, doğal dili anlamak ve üretmek için tasarlanmış bir yapay zeka modelidir. Milyarlarca parametreden oluşur ve büyük miktarda metin üzerinde eğitilerek bir cümledeki bir sonraki kelimeyi tahmin eder. LLM'ler otomatik çeviri, metin özetleme ve konuşma aracıları gibi uygulamalarda kullanılır.

Apache 2.0 lisansı nedir ve açık kaynak projeleri için neden önemlidir?

Apache 2.0 lisansı, kullanıcıların önemli değişiklikler yapmasına ve ticari veya özel amaçlarla yazılımı kullanmasına izin veren açık kaynaklı bir yazılım lisansıdır ve patent hakları tanır. Önemlidir çünkü katkıların ücretsiz ve erişilebilir kalmasını sağlar, yeniliği ve yeni teknolojilerin benimsenmesini teşvik eder.