În scurt : Asistentul conversațional Meta AI este cel mai intruziv în materie de colectare a datelor personale, depășind Google Gemini, conform unui studiu Surfshark. Meta AI colectează 32 de tipuri de date din 35 analizate, inclusiv informații sensibile precum orientarea sexuală, credințele religioase și datele biometrice, în timp ce alte aplicații precum ChatGPT de la OpenAI adoptă o abordare mai prudentă.

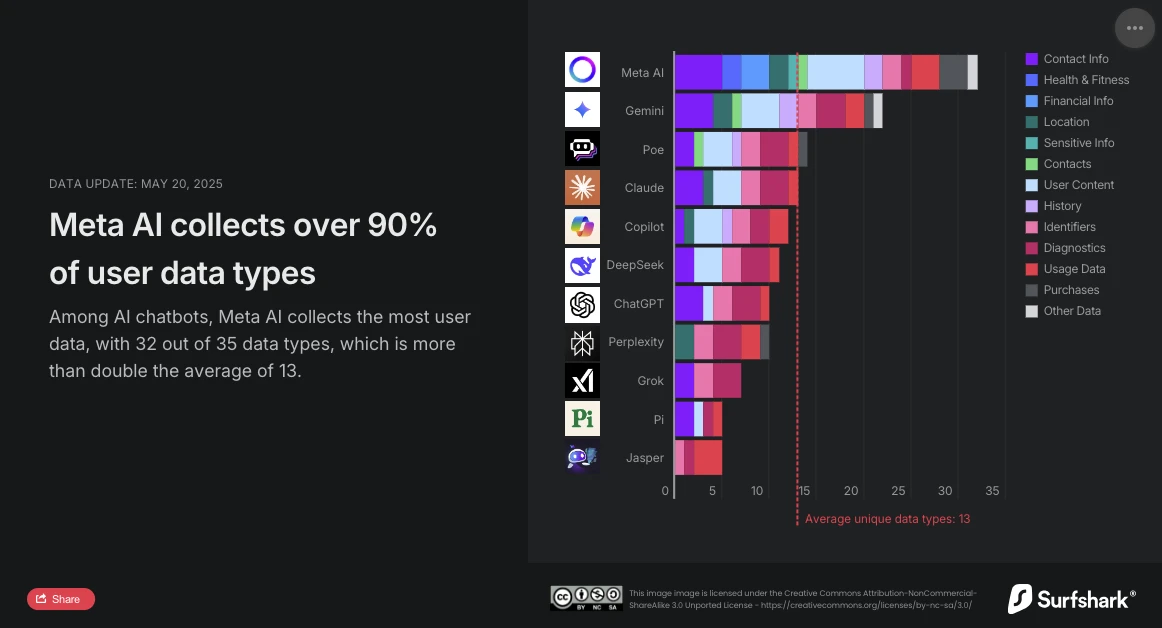

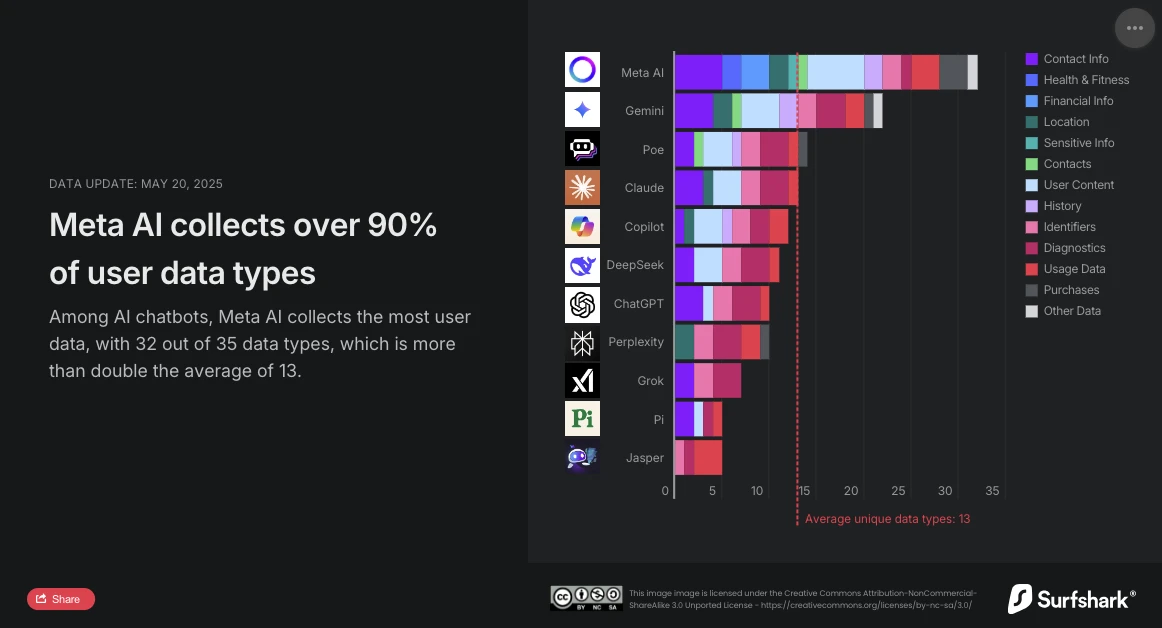

Surfshark, specialist în securitate cibernetică, a publicat recent o actualizare a studiului său comparativ privind colectarea de date personale de către principalii chatbots de pe piață. Analiza este clară: Meta AI este asistentul conversațional cel mai intruziv. Cu 32 de tipuri de date colectate din cele 35 analizate, depășește cu mult media (13 tipuri de date) și devansează acum Google Gemini, care ocupa anterior primul loc.

Din anii 2010, marile platforme și-au construit dominația pe monetizarea atenției (publicitate țintită, algoritmi de recomandare). Odată cu apariția IA generativă, se conturează un nou paradigm: nu doar captarea atenției, ci interacțiunea directă cu utilizatorul în spații din ce în ce mai personalizate și contextuale.

Meta, prin integrarea asistentului său în ecosistemul Facebook/Instagram, trece un prag în exploatarea datelor. Consimțământul utilizatorului, adesea diluat în interfețe complexe și politici de confidențialitate opace, pare din ce în ce mai simbolic.

Meta AI, cel mai avid de date

Studiul Surfshark evidențiază amploarea colectării de date de către chatbots IA: toate aplicațiile analizate colectează date ale utilizatorilor, 45% colectează geolocația, și aproape 30% (inclusiv Jasper, Poe și Copilot) practică tracking-ul publicitar, adică își încrucișează datele cu cele ale altor servicii sau le vând către brokeri de date.

Brokerii de date sunt companii specializate în achiziția și vânzarea de date personale. Ele compilează informații provenind din aplicații, site-uri web și baze de date publice pentru a crea profiluri detaliate ale utilizatorilor, revândute apoi către agenți de publicitate, asigurători, angajatori, și uneori chiar către organisme publice.

Dintre cele mai mari companii din sector, se numără Acxiom, Experian, Epsilon și Oracle Data Cloud, care câștigă miliarde de dolari exploatând aceste informații. În ciuda reglementărilor în creștere în anumite regiuni, piața rămâne puțin reglementată la nivel mondial.

Potrivit studiului, Meta AI este singurul care colectează date despre informațiile financiare, sănătate și formă fizică. Aplicația nu se oprește aici: este, de asemenea, singura care colectează informații deosebit de sensibile: date rasiale sau etnice, orientare sexuală, informații despre sarcină sau naștere, dizabilitate, credințe religioase sau filosofice, apartenență sindicală, opinii politice, informații genetice sau date biometrice.

Maud Lepetit, responsabilă pentru Franța la Surfshark, avertizează:

"Meta nu se mulțumește să aspire datele prin Facebook, Instagram sau rețeaua sa de audiență. Astăzi, aplică aceeași logică și asistentului său IA, hrănindu-l cu publicații publice, fotografii, mesaje... dar și cu date introduse direct în interfață. Este o nouă demonstrație a derivelor posibile când IA generativă se bazează pe date personale fără măsuri de protecție".

Meta AI este de asemenea singurul, alături de Copilot, care colectează date legate de identitatea utilizatorului pentru a le partaja cu terți în scopuri de publicitate țintită. Totuși, cu 24 de tipuri de date exploatate, se distinge clar de Copilot, care folosește doar două (ID dispozitiv și date publicitare).

ChatGPT, o strategie de moderare

OpenAI adoptă o abordare mai prudentă. Cu doar 10 tipuri de date colectate, printre care coordonatele, conținutul utilizatorului, datele de utilizare și de diagnostic, ChatGPT nu recurge nici la urmărirea publicitară, nici la partajarea cu terți în scopuri comerciale. În plus, opțiunea "chat-urilor temporare", șterse după 30 de zile, oferă un compromis interesant între continuitatea serviciului și respectul pentru viața privată. Utilizatorii săi pot, de asemenea, să solicite OpenAI ștergerea datelor lor pentru antrenarea modelelor sale.

DeepSeek, între discreție aparentă și riscuri concrete

Soluția chineză DeepSeek se poziționează la mijloc cu 11 tipuri de date colectate, inclusiv istoricul chat-urilor. Totuși, locul de stocare al datelor (Republica Populară Chineză) și o încălcare majoră de securitate raportată de The Hacker News (scurgerea a peste un milion de înregistrări de conversații) amintesc că localizarea serverelor și practicile de securitate cibernetică cântăresc la fel de mult ca numărul de date colectate.

Datele utilizatorilor europeni exploatate de Meta începând de săptămâna aceasta

În timp ce Meta va începe colectarea de date în Franța și în Europa începând cu data de 27 mai pentru a antrena modelele sale IA, Maud Lepetit reamintește:

"Spre deosebire de un om, IA generativă nu dă socoteală. Poate învăța orice, dar nu poate dezvăța. Ceea ce introduceți într-un chatbot rămâne în sistemul său, potențial pentru totdeauna".

Dacă vă opuneți exploatării datelor dvs. personale de către Meta, trebuie să faceți acest lucru înainte de această dată limită. Abordarea sa, care se bazează pe principiul "opt-out", unde utilizatorul trebuie să își exprime refuzul, mai degrabă decât pe un consimțământ explicit ("opt-in"), ridică întrebări cu privire la conformitatea sa cu GDPR. Interesul legitim invocat de Meta pentru a justifica această colectare fără consimțământ prealabil a determinat NYOB și asociațiile de consumatori să-și continue acțiunile împotriva companiei. CNIL, pe de altă parte, consideră că recursul la interesul legitim ca bază legală pentru antrenarea unui sistem IA nu este ilegal în sine, dar necesită o evaluare atentă a intereselor și drepturilor fundamentale ale persoanelor vizate.

Pentru a înțelege mai bine

Ce este RGPD și cum se aplică practicilor de colectare a datelor de către Meta AI?

RGPD (Regulamentul General privind Protecția Datelor) este o reglementare a UE menită să protejeze datele personale ale indivizilor. Acesta necesită consimțământ explicit ('opt-in') pentru colectarea și utilizarea datelor. În cazul Meta AI, care folosește consimțământul 'opt-out', există dezbateri despre conformitatea cu RGPD, conducând la acțiuni legale.

Cum este folosit conceptul de 'interes legitim' în reglementarea datelor personale?

Interesul legitim este o bază legală sub RGPD pentru procesarea datelor fără un consimțământ explicit. Este necesar ca companiile să arate că interesele lor legale nu depășesc drepturile fundamentale ale indivizilor. Este o bază controversată, deoarece aplicarea sa depinde de o evaluare echilibrată care poate fi subiectivă.