Samenvatting

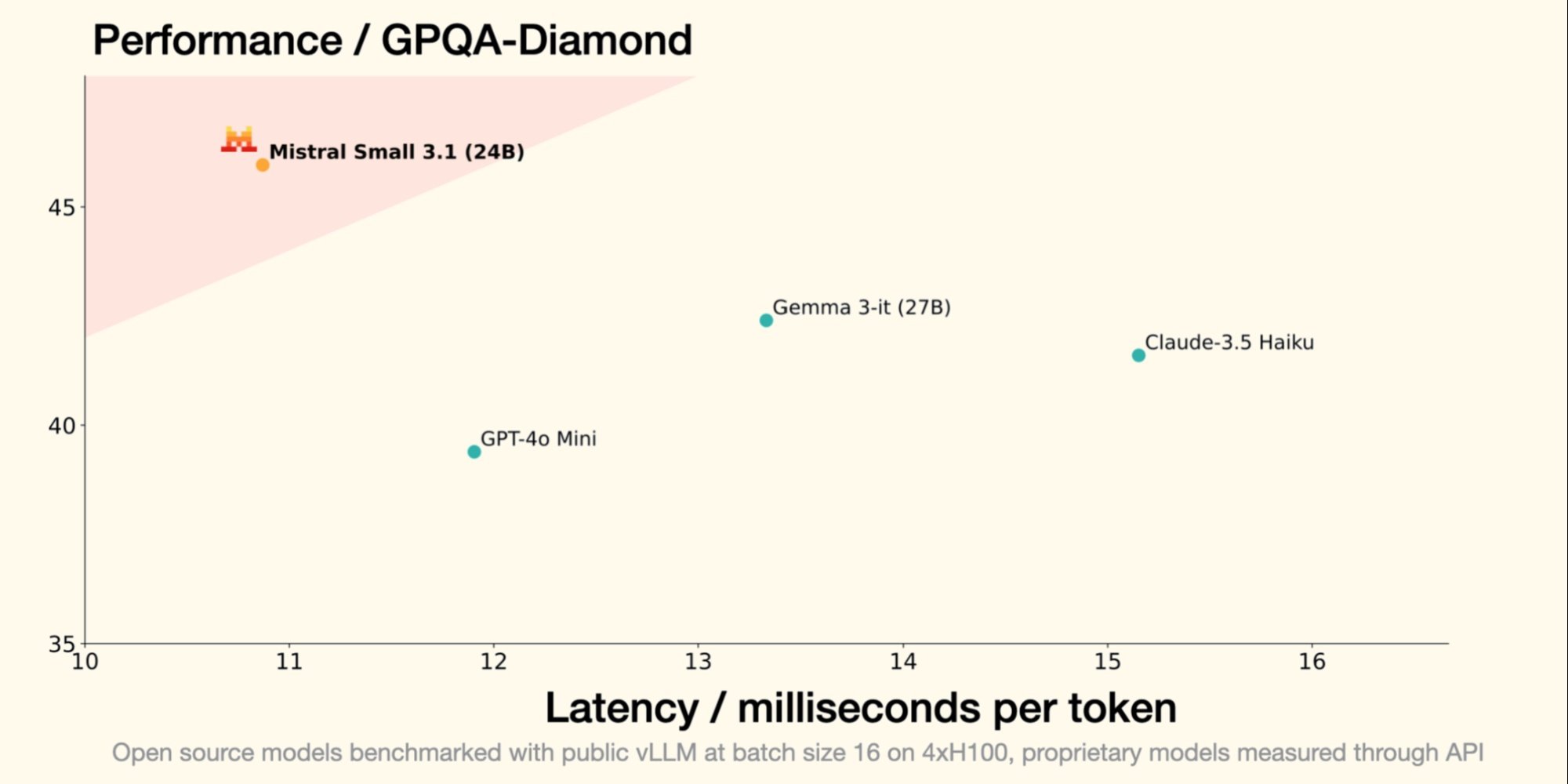

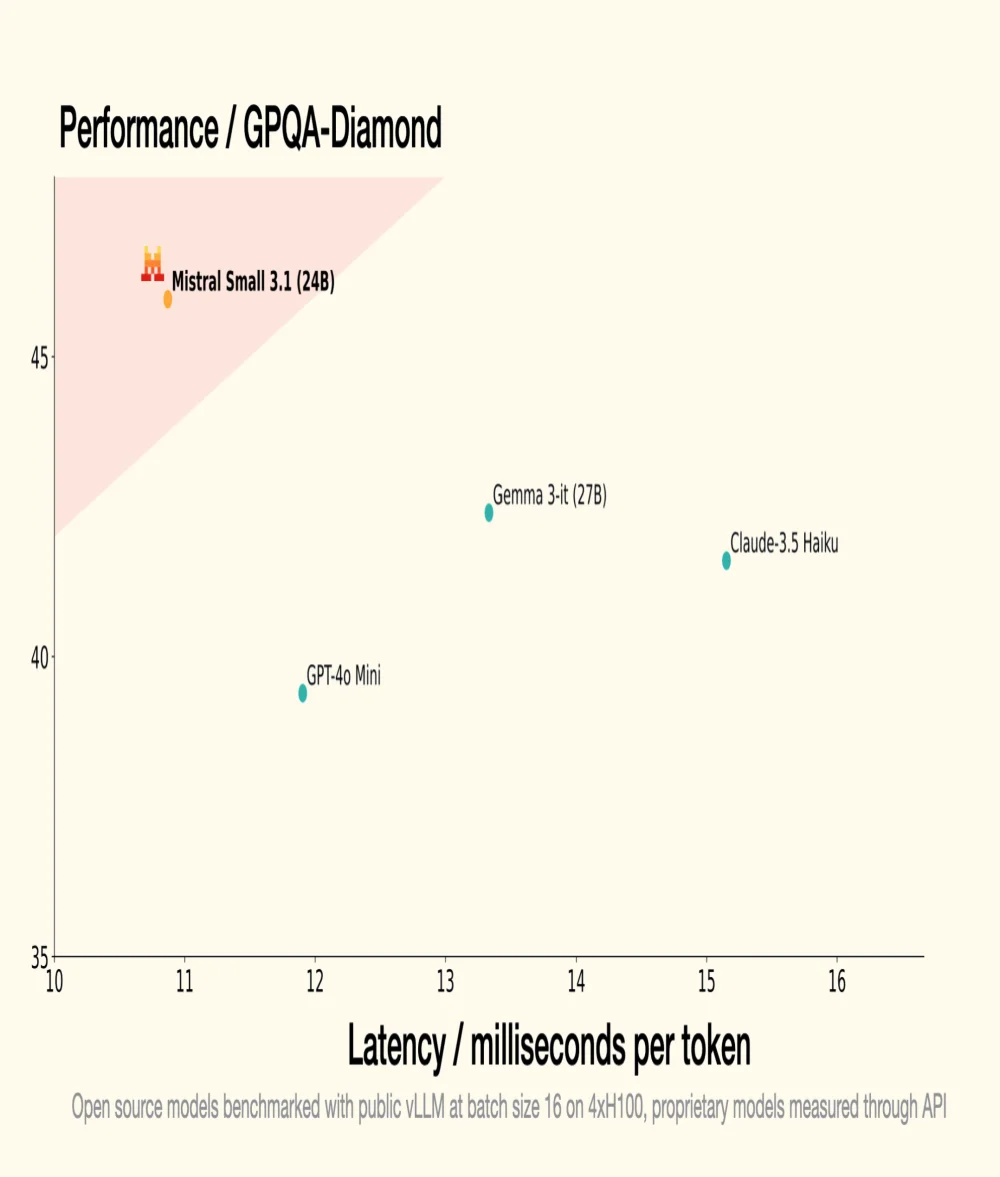

Op 30 januari introduceerde de Franse unicorn Mistral AI de Small 3, een LLM met 24 miljard parameters, waarmee werd aangetoond dat een LLM niet een astronomisch aantal parameters nodig heeft om goed te presteren. Small 3.1, zijn opvolger, behoudt een compacte architectuur en introduceert tegelijkertijd aanzienlijke verbeteringen op het gebied van prestaties, multimodale begrip en lange contextbeheer, waardoor het modellen zoals Google’s Gemma 3-it 27B en OpenAI's GPT-4o Mini overtreft.

Bron: Mistral AI

Optimalisatie van de prestaties

- Een geïnstrueerde versie, Mistral Small 3.1 Instruct, klaar voor gebruik voor gespreks- en taalbegripstaken;

- Een voorgetrainde versie, Mistral Small 3.1 Base, ideaal voor fine-tuning en specialisatie in specifieke domeinen (gezondheid, financiën, juridisch, etc.).

- Toont Small 3.1 Instruct betere prestaties dan Google’s Gemma 3-it (27B) bij tekstuele, multimodale en meertalige taken;

- Overtreft het GPT-4o Mini van OpenAI in benchmarks zoals MMLU, HumanEval en LongBench v2, met name dankzij zijn uitgebreide contextvenster tot 128.000 tokens;

- Overschrijdt het ook Claude-3.5 Haiku bij complexe taken die lange contexten en multimodale gegevens omvatten;

- Excelleert het tegenover Cohere Aya-Vision (32B) in multimodale benchmarks zoals ChartQA en DocVQA, waarmee het een geavanceerd begrip van visuele en tekstuele gegevens aantoont;

- Toont Small 3.1 hoge prestaties in meertaligheid, en overtreft het zijn concurrenten in categorieën zoals Europese en Aziatische talen.

Beter begrijpen

Wat is een LLM (Large Language Model) in termen van technologie en functie?

Een LLM is een kunstmatig intelligentiemodel dat ontworpen is om natuurlijke taal te begrijpen en te genereren. Het bestaat uit miljarden parameters die worden aangepast door training op grote hoeveelheden tekst om het volgende woord in een zin te voorspellen. LLM's worden gebruikt voor toepassingen zoals automatische vertaling, tekstsamenvattingen en conversatieagenten.

Wat is de Apache 2.0-licentie en waarom is deze belangrijk voor open-sourceprojecten?

De Apache 2.0-licentie is een open-source softwarelicentie die gebruikers in staat stelt aanzienlijke wijzigingen aan te brengen en de software voor commerciële of privédoeleinden te gebruiken, terwijl patenten worden verleend. Het is belangrijk omdat het ervoor zorgt dat bijdragen vrij en toegankelijk blijven, wat innovatie en de acceptatie van nieuwe technologieën bevordert.