In kort : Cohere introduceert Command A, een efficiënt en krachtig LLM voor bedrijven, met minder GPU-behoefte en uitstekende prestaties in meertalige en complexe juridische contexten.

De Canadese unicorn Cohere heeft onlangs “Command A” onthuld, de nieuwste versie van zijn vlaggenschipmodel. Speciaal ontworpen, net als zijn voorgangers, om te voldoen aan de behoeften van bedrijven, combineert dit LLM van 111 miljard parameters prestaties met energie-efficiëntie en concurreert het met toonaangevende modellen zoals GPT-4o en DeepSeek-V3.

Een van de belangrijkste voordelen van Command A voor bedrijven is de minimale materiaalvoetafdruk. Waar de meeste vergelijkbare modellen tot 32 GPU's nodig hebben, werkt Command A efficiënt met slechts twee GPU's A100 of H100, wat resulteert in een aanzienlijke kosten- en latentievermindering en een hogere uitvoeringssnelheid. Naast een snellere generatie van de eerste token, kan het tot 156 tokens/s genereren, wat 1,75 keer sneller is dan GPT-4o en 2,4 keer sneller dan DeepSeek-V3.

Prestaties van Command A

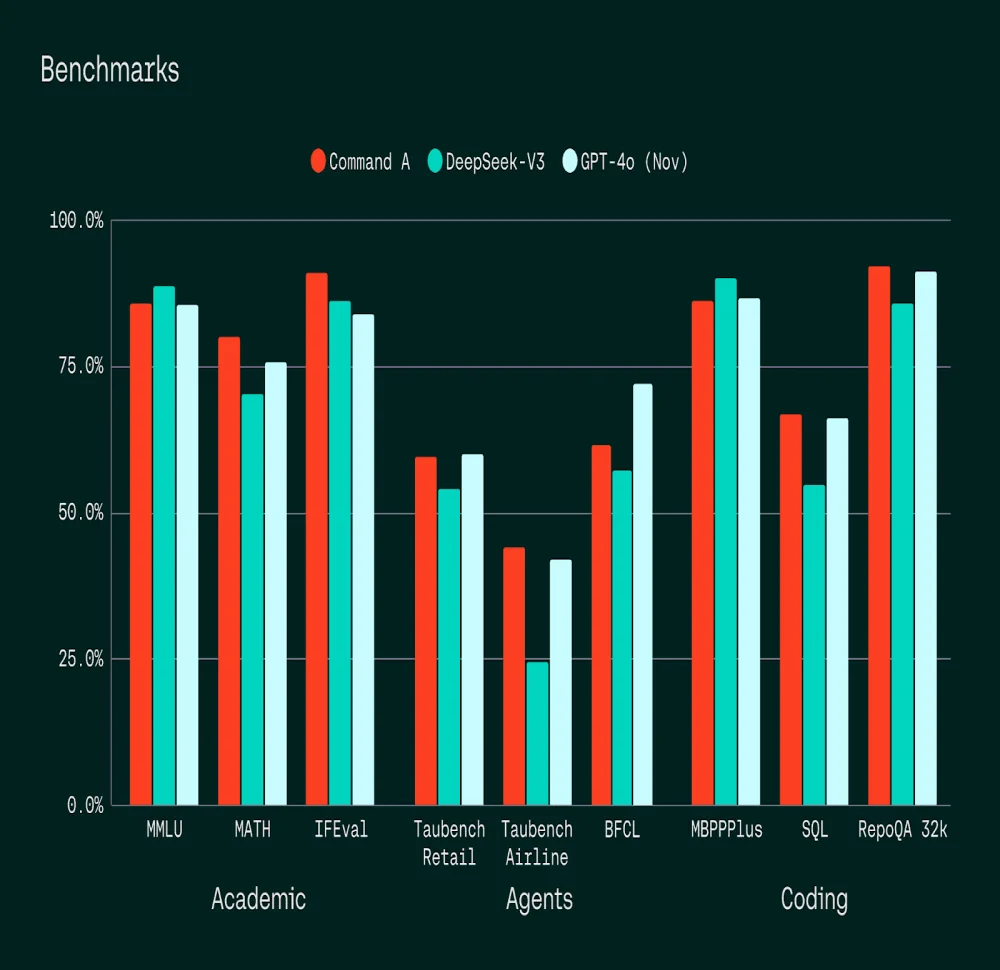

Cohere heeft de prestaties van Command A geëvalueerd ten opzichte van GPT-4o en DeepSeek-V3, op academische benchmarks: MMLU (algemene kennis), MATH, IFEval (instructievolging), intelligente agenttests (BFCL, Taubench) en codeerbenchmarks (MBPPPlus, SQL, RepoQA).

Zijn capaciteiten op het gebied van instructievolging, codering, met name in SQL, en op agentische taken overtreffen die van zijn concurrenten.

In menselijke evaluatietests heeft Command A, dat 23 van de belangrijkste talen dekt, zijn concurrenten overtroffen in verschillende talen, met name in dialectisch Arabisch, waar het coherenter en nauwkeuriger bleek te zijn dan GPT-4o en DeepSeek-V3. Dit vermogen om zich aan te passen aan lokale contexten vertegenwoordigt een strategisch voordeel voor internationaal opererende bedrijven.

Geoptimaliseerde capaciteiten voor bedrijven

In tegenstelling tot zijn voorganger, die een contextlengte van 128.000 tokens ondersteunde, heeft Command A een contextlengte van 256 tokens, waardoor het geschikt is voor het analyseren van lange bedrijfsdocumenten. Het integreert geavanceerde functies zoals generatie vergroot door retrieval (RAG) met verifieerbare citaten en het gebruik van veilige agentische tools.

Het is bijzonder effectief voor:

Het analyseren en extraheren van informatie uit omvangrijke financiële rapporten;

Het beheren van HR-beleid volgens lokale specificiteiten;

Het verifiëren en interpreteren van complexe juridische voorschriften.

Dankzij een soepele integratie met North, het IA-agentenplatform van Cohere, stelt Command A bedrijven in staat om op maat gemaakte IA-oplossingen te ontwikkelen terwijl een hoog niveau van beveiliging en naleving wordt gehandhaafd.

Beschikbaarheid en prijsstelling

Nu al beschikbaar op het Cohere-platform, met binnenkort ondersteuning door de belangrijkste cloudproviders, wordt Command A aangeboden tegen een kostprijs van $2,50 per 1 miljoen tokens in input en $10,00 per 1 miljoen tokens in output. Het is ook toegankelijk voor onderzoeksdoeleinden op Hugging Face.

Beter begrijpen

Wat is een LLM en waarom is het belangrijk voor bedrijven?

Een LLM (Groot Taalmodel) is een kunstmatig intelligentiemodel dat enorme hoeveelheden data gebruikt om natuurlijke taal te begrijpen, genereren en manipuleren. Voor bedrijven kan dit de operaties transformeren door klantenservice te stroomlijnen, complexe data te analyseren en communicatie en besluitvorming te verbeteren.

Hoe verbetert Retrieval-Augmented Generation (RAG) de capaciteiten van een LLM zoals Command A?

RAG, of Retrieval-Augmented Generation, stelt een LLM in staat zijn reacties te verrijken met actuele en relevante externe gegevens. Dit gebeurt door te raadplegen van externe databases of documenten, de verstrekte informatie te verifiëren en de nauwkeurigheid en relevantie van de gegenereerde outputs te verhogen.