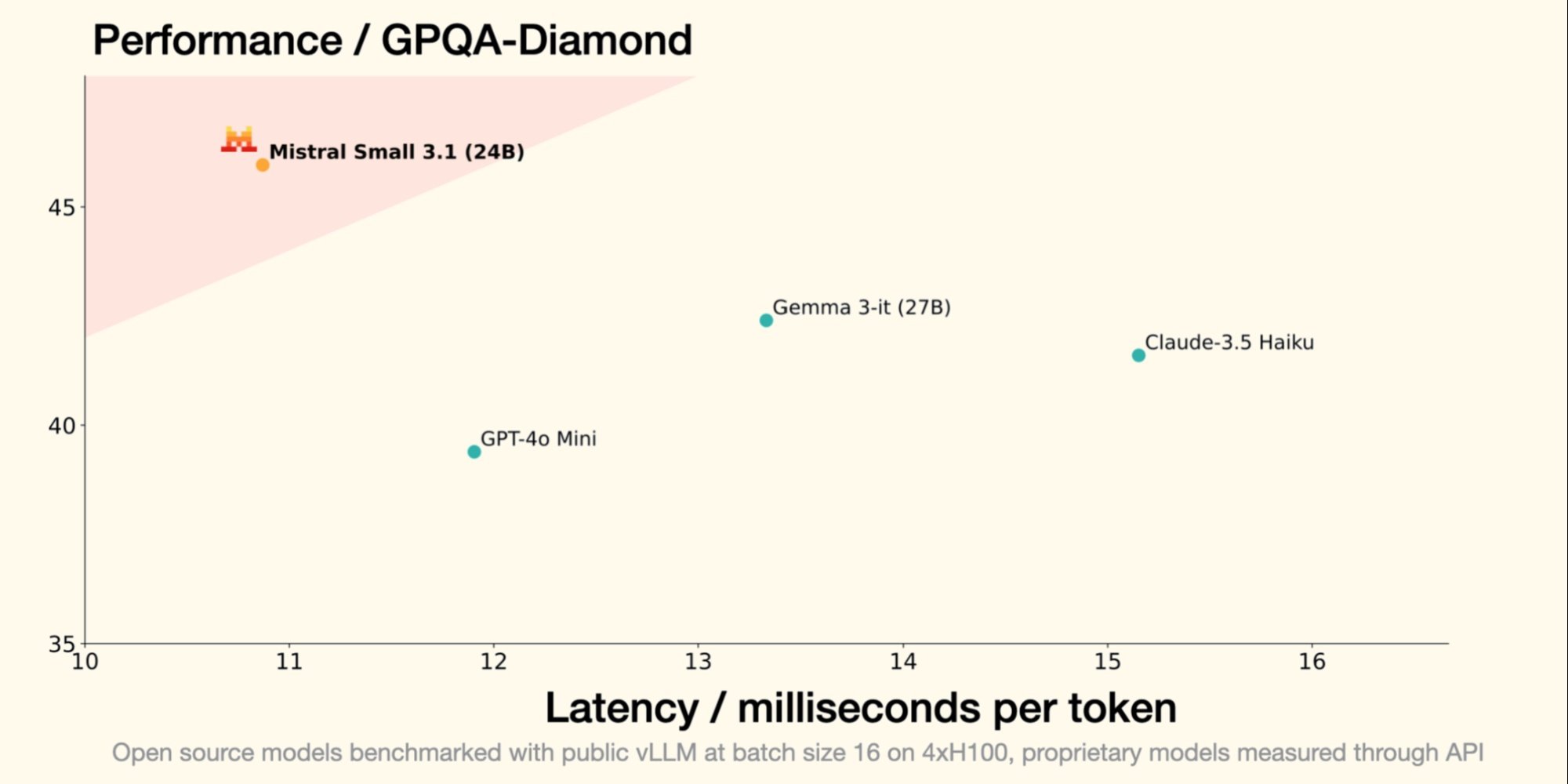

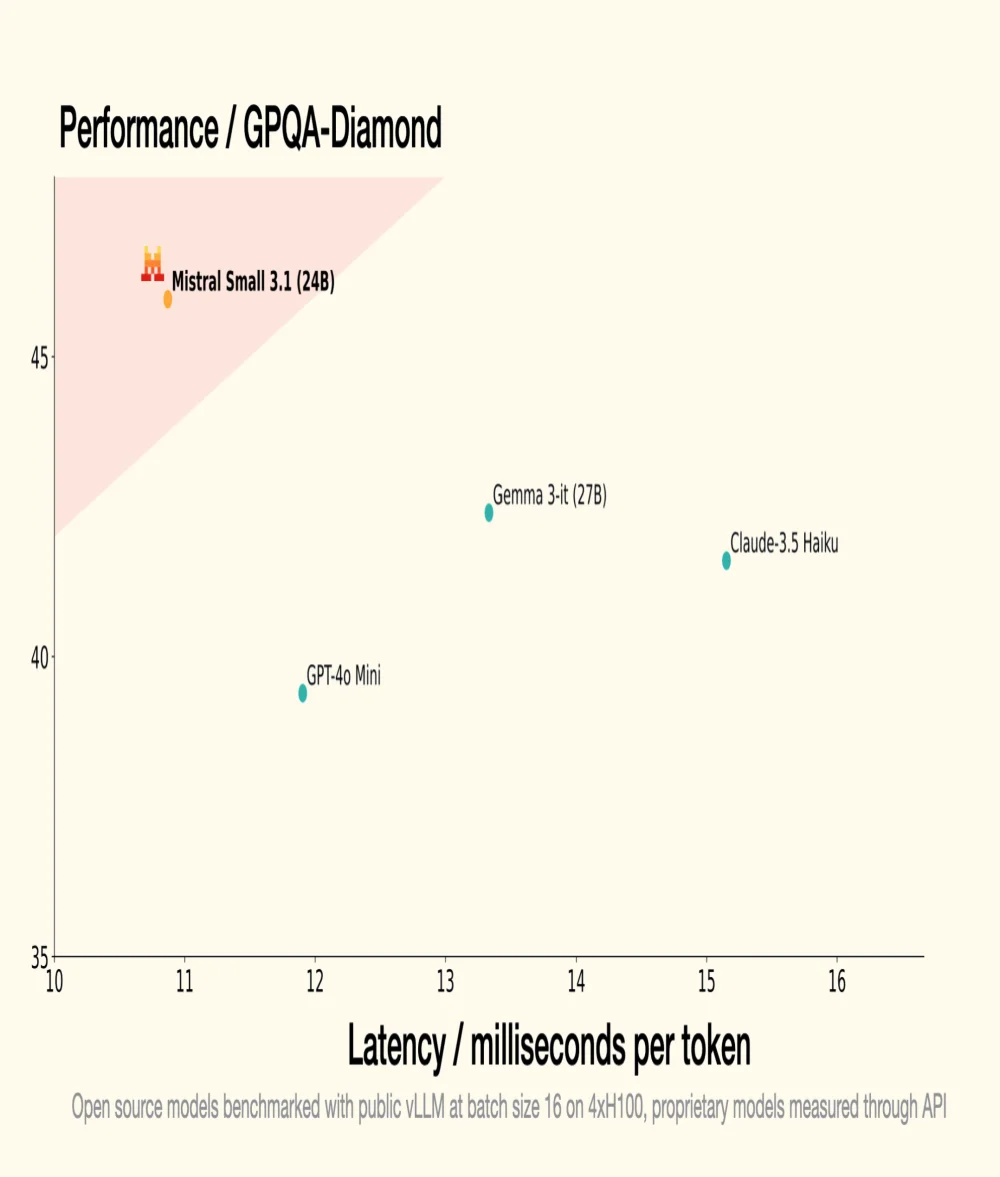

Am 30. Januar führte Mistral AI, das französische Einhorn der GenAI, Small 3 ein, ein LLM mit 24 Milliarden Parametern, das zeigt, dass ein leistungsstarkes LLM keine astronomische Anzahl von Parametern benötigt. Small 3.1, sein Nachfolger, behält eine kompakte Architektur bei und bietet gleichzeitig signifikante Verbesserungen in Bezug auf Leistung, multimodales Verständnis und Handhabung langer Kontexte, wodurch Modelle wie Gemma 3-it 27B von Google und GPT-4o Mini von OpenAI übertroffen werden.

Quelle: Mistral AI

Leistungsoptimierung

- Eine instruierte Version, Mistral Small 3.1 Instruct, bereit für den Einsatz in konversationellen Aufgaben und Sprachverständnis;

- Eine vortrainierte Version, Mistral Small 3.1 Base, ideal für das Feintuning und die Spezialisierung auf spezifische Bereiche (Gesundheit, Finanzen, Recht, etc.).

- Zeigt Small 3.1 Instruct bessere Leistungen als Gemma 3-it (27B) von Google in textuellen, multimodalen und mehrsprachigen Aufgaben;

- Es übertrifft GPT-4o Mini von OpenAI bei Benchmarks wie MMLU, HumanEval und LongBench v2, insbesondere dank seines erweiterten Kontextfensters von 128.000 Tokens;

- Es übertrifft auch Claude-3.5 Haiku bei komplexen Aufgaben, die lange Kontexte und multimodale Daten beinhalten;

- Es brilliert gegenüber Cohere Aya-Vision (32B) bei multimodalen Benchmarks wie ChartQA und DocVQA und zeigt ein fortschrittliches Verständnis von visuellen und textuellen Daten;

- Small 3.1 zeigt hohe Leistungen im Multilingualismus und übertrifft seine Konkurrenten in Kategorien wie europäischen und asiatischen Sprachen.

Besser verstehen

Was ist ein LLM (Large Language Model) in Bezug auf Technologie und Funktion?

Ein LLM ist ein KI-Modell, das entwickelt wurde, um natürliche Sprache zu verstehen und zu erzeugen. Es besteht aus Milliarden von Parametern, die durch Training mit großen Textmengen angepasst werden, um das nächste Wort in einem Satz vorherzusagen. LLMs werden in Anwendungen wie automatischer Übersetzung, Textzusammenfassung und Konversationsagenten eingesetzt.

Was ist die Apache 2.0 Lizenz und warum ist sie für Open-Source-Projekte bedeutend?

Die Apache 2.0 Lizenz ist eine Open-Source-Softwarelizenz, die es Benutzern ermöglicht, erhebliche Änderungen vorzunehmen und die Software für kommerzielle oder private Zwecke zu verwenden, während Patente gewährt werden. Sie ist bedeutend, weil sie sicherstellt, dass Beiträge frei und zugänglich bleiben, was die Innovation und die Einführung neuer Technologien fördert.